トラストハブの中村です。普段は統計・機械学習を用いた toC 向け自社サービスの改善に取り組んでおり、最近だと拡散モデルや検索・レコメンド領域に興味を持っています。

今回は 第42回 International Conference on Machine Learning (ICML 2025) に参加してきたので、印象に残ったセッションの感想も交えながら体験記をまとめたいと思います。

ICML とは?

ICML(International Conference on Machine Learning) は機械学習分野を代表する国際会議で、理論的な基礎研究から産業界への応用まであらゆる側面に関する最先端の研究成果が発表・出版される場です。2025 年は 7 月 13〜19 日(現地時間)にカナダのバンクーバーで開催されました。

会場 – Vancouver Convention Centre

なお、スケジュールおよび各セッションのアブストラクトについては 公式サイト から確認することができます。

近年の機械学習研究は、学術界が築き上げてきた理論的枠組みと、産業界で発展してきた実装・運用のノウハウが相互補完的に結びつくことで、かつてないスピードで進化してきています。ICML 2025 も例外ではなく、招待講演からポスターセッションに至るまで「理論的な基礎研究」と「応用的なプロダクション実装」が同じ会場で熱く語られる光景が印象的でした。

ICML 2025 – スポンサー看板

私自身、実際の現場で統計学や機械学習を活用する立場として、理論の理解を深めるのと実際のビジネスでの創造的な応用面の発見を求めて参加しました。結果、想像を上回る収穫と知的刺激に満ちた、充実した一週間となりました。

会場の雰囲気

ICML 2025 は、バンクーバー・ダウンタウンの Vancouver Convention Centre が会場でした。こちらは毎年の TED カンファレンスの本拠地としても知られており、巨大なボールルームに組み立て式の TED シアターが設営されることでも有名です。

会場の一部 – West Exhibition Hall C

とにかく会場が広く、講演の合間に移動するだけでも一苦労です。また、ポスターセッションは全 6 回に分かれており、どれも West 会場と East 会場で並行開催されます。West と East の移動だけでも徒歩 5〜10 分ほどかかるうえ、会場自体が圧倒的に広大で、1 回のポスターセッションで両会場合わせてポスターは約 500 件あったと思います。そのため、限られた時間内にすべてを見て回り、深い議論まで行うのは現実的ではありません。そこで、私は各セッション前に興味のあるポスターを入念にリサーチしてから参加するようにしていました。そのおかげで、実際に何人かの発表者とは口頭で有意義な議論ができたと思います。

ポスターセッション

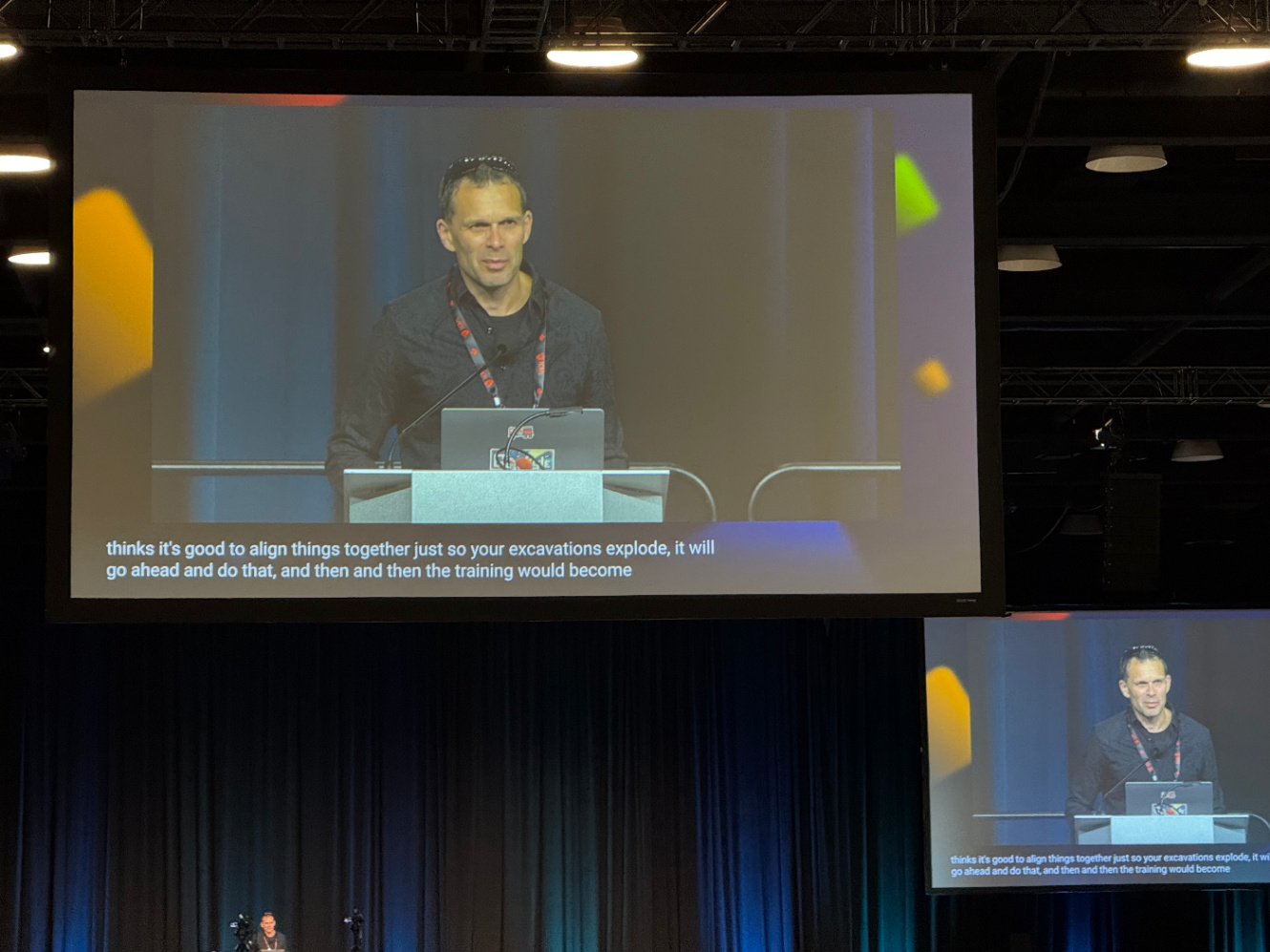

運営面の工夫も印象的でした。講演中には発表者の映像が映し出されるモニターに、英語字幕がリアルタイムで表示されます。地域ごとの訛りにも完璧に対応しており、専門用語も高精度で翻訳されるため、英語が母語でない参加者や大ホール特有の聞き取りにくさを感じる場面でも非常に助かっていました。

自動字幕 – 発表者は Sergey Ioffe 氏

また、当日は公式イベントアプリ「Whova」に参加者アカウントが紐付けられており、セッション情報の確認や参加者同士の連絡・告知がスムーズに行えました。実際に、アプリを通じて日本人同士で食事に出かけたり、突発的なイベントがいくつか発生していたようで、私は参加しませんでしたがオフの日にはバンクーバーでのサイクリングを企画していたグループもあったようです。カンファレンス期間中の緩やかな繋がりを後押ししてくれる、とてもありがたい仕組みでした。

Coffee Break

さらに、昼食休憩では希望者全員に lunch box が無料で配布されました。おそらく世界中から多人数が集まっていたであろう大規模な国際会議で、この規模での無料提供には驚かされました。lunch box のサンドイッチはどれも美味しくいただきました。

昼食休憩中に無料で提供されていた lunch box

印象に残ったセッション

セッションは招待講演を除いてほぼすべてのセッションで並行開催のため、自分の関心がありビジネスに繋がりそうな拡散モデルや検索・レコメンド領域、そして自分のバックグラウンドである数学・統計学に近い発表を選んで参加しました。特にポスターセッションでは、これらのテーマに該当する発表を優先的に選んで回り、いくつかのブースでは発表者と口頭で議論を深めることもできました。以下では、印象に残った論文をいくつか紹介させていただきます。

DeFoG: Discrete Flow Matching for Graph Generation

- 口頭発表:Oral 2A “Diffusion Models”(7 月 15 日 15:30–16:30, PDT)

- ポスター発表:Spotlight Poster/会場 East Exhibition Hall A–B(#E-3004)/(7 月 15 日 16:30–19:00, PDT)

最近話題の Flow Matching についてグラフ生成に特化したフレームワーク DeFoG というものを提案するという論文です。拡散モデルのグラフ生成への応用は以前から研究されており、分子化学からソーシャルネットワーク分析まで幅広い分野で高い性能が報告されていました。その一方で、サンプリング効率の悪さやモデルの柔軟性など様々な課題も指摘されていました。

DeFoG は Generative Flows on Discrete State-Spaces: Enabling Multimodal Flows with Applications to Protein Co-Design (Campbell et al., ICML 2024) の Discrete Flow Matching をベースにした、グラフ構造に特化して設計されたフレームワークです。DeFoG の新規性は、トレーニング (noising) とサンプリング (denoising) を明確に分離した Discrete Flow Matching をグラフ向けに初めて本格的に定式化し、グラフ特有の対称性を重視した点にあります。論文では、合成・分子・デジタル病理などのさまざまなデータセットに対して、従来の拡散モデルと比較して、わずか 5〜10% 程度のサンプリングステップ数で優れた結果を達成していることを報告しています。

なお、これはポスターセッションの会場で一通りポスターを見て回った自分が感じたことですが、拡散モデル領域における Flow Matching 関連研究のポスターが多かった印象で、会場の熱量からもこのテーマの注目度の高さを実感しました。

Train for the Worst, Plan for the Best: Understanding Token Ordering in Masked Diffusions

- 口頭発表:Oral 2A “Diffusion Models”(7 月 15 日 15:30–16:30, PDT)

- ポスター発表:Spotlight Poster/会場 East Exhibition Hall A–B(#E-3009)/(7 月 15 日 16:30–19:00, PDT)

Google の Gemini Diffusion や Inception Labs が開発した Mercury Coder など、テキスト生成などの離散領域において拡散モデルを応用したプロダクトが近年話題です。この研究では、離散領域で最近になって注目されている masked diffusion models (MDMs) と既存の自己回帰モデル (ARMs) との比較をが詳細に行われています。

著者らは、MDM では学習時において数学的に扱いにくいブランク埋めのサブ問題が指数関数的に増加し、そのことが学習を困難にし得ると指摘します。その一方で、MDM にはサンプリング (decoding) の際に unmask の順序を任意に設定できるという利点があります(対照的に、自己回帰モデルの場合は token を左から右へ順次生成するように訓練されます)。この研究では、この利点を活かして adaptive な選択的順序を採用することで、前述の難しさを緩和できる、ということを示しています。

実験では、この addaptive な選択的順序を採用することで、数独ベンチマークの精度が 7% 未満から約 90 %にまで向上したそうです。これは、Vanilla ARM だけでなく、正しいデコード順序を学習するために teacher forcing によって明示的にトレーニングされた ARM(パラメータ数が7倍多いものも含む)をも上回る精度のようです。

Score Matching with Missing Data

- 口頭発表:Oral 5C “Probablistic Models”(7 月 17 日 10:00–11:00, PDT)

- ポスター発表:Spotlight Poster/会場 East Exhibition Hall A–B(#E-1507)/(7 月 17 日 11:00–13:30, PDT)

拡散モデルやエネルギーベースモデル、グラフィカルモデルなどで使われるスコアマッチングの手法について、欠損値を含むデータの場合でもスコア関数の学習ができるアプローチを提案する論文です。従来の手法では完全なデータを前提にしていたため、現実世界で頻出するような欠損値を含む場合にはそのまま適用しづらいという課題がありました。

欠損値を含むデータの場合に、データ分布の完全なスコア関数を学習するために、この論文では marginal score matching という手法が提案されています。これは、元々の正規化されていない分布を欠損している座標全体で周辺化したスコア関数 (marginal score) を学習して行われるスコアマッチングです。また、この論文ではこの学習方法について (1) importance weighting (2) gradient first approach という 2 種類のアプローチが説明されています。

Neural Discovery in Mathematics: Do Machines Dream of Colored Planes?

- 口頭発表:Oral 5D “Applications in Math and Physics”(7 月 17 日 10:00–11:00, PDT)

- ポスター発表:Spotlight Poster/会場 West Exhibition Hall B2–B3(#W-401)/(7 月 17 日 11:00–13:30, PDT)

自分のバックグラウンドは純粋数学で、機械学習の数学への応用には以前から強い関心がありました。ICML 2025 では 5 日目に “Applications in Math and Physics” というセッション、6 日目に “AI for Math” というワークショップが開催されました。ここでは、その中でも印象に残った古典的未解決問題 Hadwiger–Nelson 問題 に挑んだ本研究について紹介します。

ユークリッド平面上の点を、距離がちょうど 1 の 2 点が同色にならないように彩色するときの最小色数(平面の単位距離グラフの彩色数)を問うのが Hadwiger–Nelson 問題です。下限については 1961 年に Moser らによって 4 色では足りないことが証明され、2018 年には A. de Grey により 5 色が必要 となる具体的構成が発見されています。上限については 1950 年には 7 色で彩色可能なことが示されています。

本研究は、機械学習を援用して次の成果を報告しています: (1) 6 色彩色の新しい構成を 2 例発見(約 30 年ぶりの改善) (2) 平面の 96.26% を 5 色で覆う「ほぼ 5 色塗り」を構成し、従来の最良値(約 95.99%)を更新 (3) 3 次元への応用として、空間の 96.54% を 14 色で覆う「ほぼ 14 色塗り」を達成 (4) 平面を特定の数の色で彩色する際に回避可能な単色三角形の範囲を拡張した(従来の最良値は Aichholzer & Perz (2019) による結果)

口頭発表を聞いていて面白いなと思ったのが、そのアプローチです。一見すると離散的な問題のようにも思えますが、実際には微分可能な損失関数の最適化問題として定式化して、問題を置き換えて解いています。

A Geometric Approach to Personalized Recommendation with Set-Theoretic Constraints Using Box Embeddings

- ポスター発表:Poster/会場 East Exhibition Hall A–B(#E-1811)/(7 月 17 日 11:00–13:30, PDT)

数は少なかったものの、自分の業務に直結しそうなレコメンド領域のポスター発表もいくつかありました。ここでは、その中でも特に興味深かったものを紹介します。

従来のレコメンドシステムでは、アイテムの埋め込みはベクトルで表現されることが多い一方で、この研究では「Box 埋め込み」(特徴量空間内での区間の直積を対応させる)を用いたレコメンドシステムを考えています。

レコメンドでは、集合論的な操作がよく登場します。例えば、ユーザーに映画をレコメンドする場合「コメディかつアクションだがロマンスではない」といった共通部分や差集合を扱うことがあります。既存のベクトル表現だと扱いづらいこれらの操作ですが、Box 埋め込みだとこれら集合論的な操作と相性がいいという利点があります。また、ベクトル表現ではアイテムの近さを測る指標としてユークリッド距離や cos 類似度などが考えられましたが、 Box 埋め込みの場合は単純に共通部分の体積(これも座標同士の単純な四則演算のみで計算できる)を用いた比率で定義することができます。

ところで、Box 埋め込みをレコメンドに応用する試みは近年よく見かけることがあり、本論文の Related Work でも触れられています。それこそ、例えば IBIS 2024 でも Box 埋め込みに関するポスター発表があったのは、私自身も当時このポスター発表を拝聴していて記憶に新しいところです(関連記事)。

本論文の新規性は、集合論的制約を伴うパーソナライズ推薦を「集合論的行列補完」として再定式化し、その問題に対して Box 埋め込みが持つ集合論的な操作との相性の良さを活用した点にあります。これにより、否定や交差などを含む複雑なクエリに対しても、汎化性能の優位性を明確に示しています。

実験結果では、MF / NeuMF / LGCN といったベクトルベースの手法と比較して、単純な推薦クエリから複合的な集合論的クエリまで一貫して高い性能が確認されており、指標 HR@50 においては平均で約 30% の改善が報告されています。また、最も複雑なクエリ

まとめ

ICML 2025 では、理論から応用まで幅広い分野・領域の発表を拝聴することができました。運営の方々および発表者の方々、そして現地にて議論に付き合っていただいた研究者の方々には本当に感謝しております。とりわけ今回は、参加にあたり旅費を出してくれた会社には大変感謝しております。会期中は本当に多くの学びがあり、自分の視野が大きく広がりました。また、開催地のバンクーバーは気候も穏やかで過ごしやすく、集中して吸収するには最高の環境でした。得た知見は業務に還元しつつ、拡散モデルや検索・レコメンド領域の動向には今後も継続して注目していこうと思います。

Vancouver Convention Centre から眺める Coal Harbour と North Shore

Views: 0