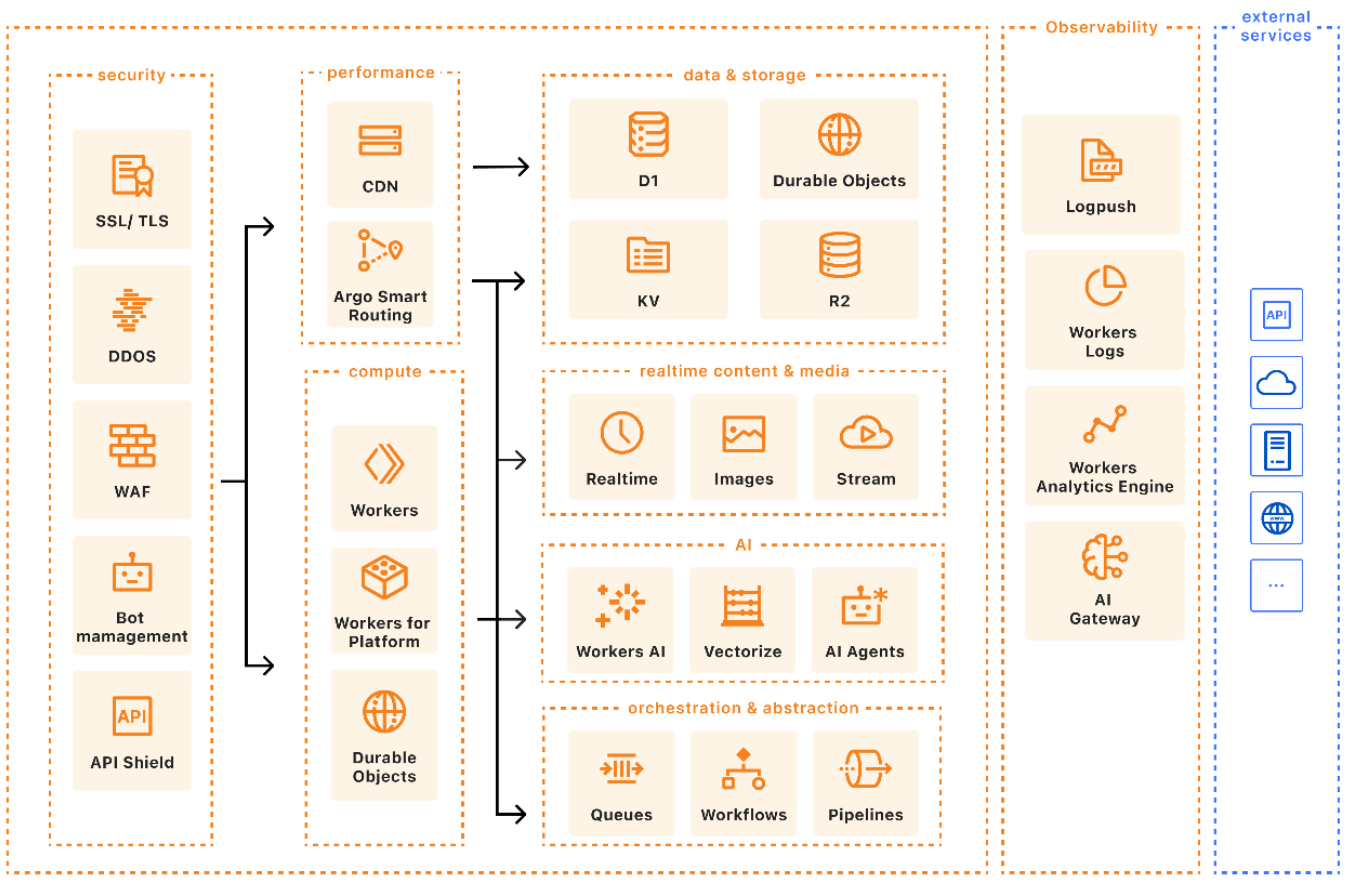

Cloudflare の AI(人工知能)関連プロダクトをエンタープライズプランのダッシュボードから探検します。とても早いペースで開発が進んでいるので、次々に新しいものが出てきますが、2025 年 7 月時点のまとめになります。またベータ 印のあるプロダクトについても記載しています。

コンピューティング(Workers)

Workers 📖 & Pages 📖

Workers や Pages Functions から AI 関連リソース(Workers AI や Vectorize)を簡単に使うことができます(Bindings)。また、サードパーティの AI モデルを SDK や fetch() などで繋ぐこともできます。

Workers AI を Binding

Workers AI と Vectorize インデックス、D1 データベースを Binding

AI

Workers AI 📖

グローバルに展開される GPU を利用し、サーバレスで AI を駆動させる Workers AI。

そこで利用できる LLM(大規模言語モデル)の一覧や使用量(単位 Neurons)を確認できます。

モデル

使用量

デモ

Workers AI のガイドにデモアプリケーションやチュートリアルがしこたま揃っているので、いろいろ試せます。

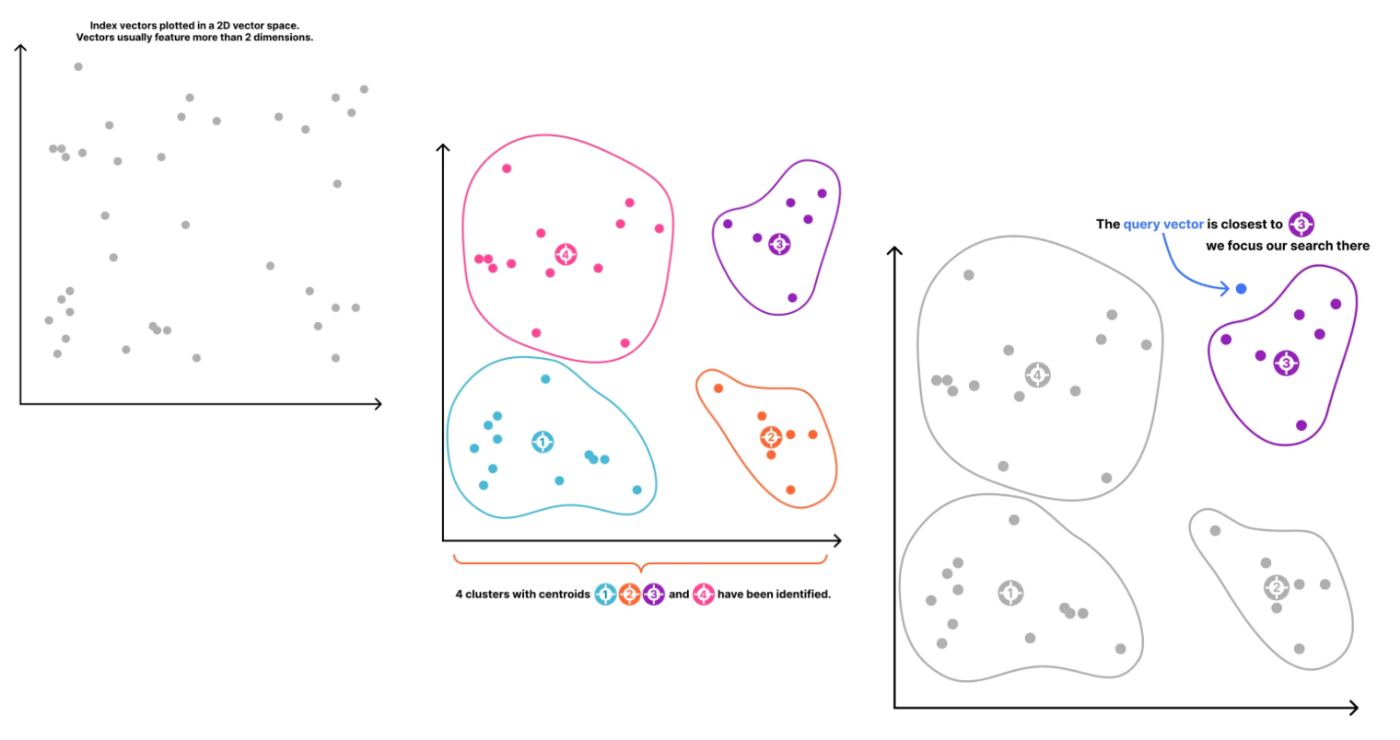

Vectorize 📖

グローバルに分散したベクトルデータベースを提供する Vectorize。

作成したインデックスの一覧や使用状況を確認できます。

作成したベクトルインデックスの一覧

使用状況

デモ

Vectorize や Embedding の説明やサンプルコードがあり、オススメです。

AI Gateway 📖

アプリケーションが Workers AI やサードパーティの モデルプロバイダーを利用するときに、ゲートウェイとして介在します。利用する LLM の可視化と制御を管理者に提供し、LLM 利用のリスクやコスト軽減対策の一部として役立ちます。

具体的には レート制限 キャッシュ 認証 フォールバック ガードレール 観測 評価 などが提供されます。

作成した AI Gateway の一覧

設定

Gateway 単位で設定します。

いろいろな項目がまとまっています。

Guardrails(執筆時点 ベータ)

Gateway 単位で設定します。プロンプトとレスポンスを監査し、選択したカテゴリーの設定の基づいて制御することが可能になります。

有効にすると、プロンプトやレスポンスを llama-guard に渡し、判断材料にしているようでした。

評価(執筆時点 ベータ)

Gateway 単位で設定がします。

指定した条件でログをフィルターし、その平均応答速度や平均コストを評価することができます。

ログ

Gatway 単位で設定します。

プロンプトとレスポンスに関する情報を取ることができます。

フィルターも定義可能です。

たとえば、ステータス Error でフィルタし、詳細を見るとレート制限が理由であったことがわかります。

デモ

-

キャッシュ

キャッシュを有効にすると、同じプロンプトのリクエストに対して応答が早くなります。

キャッシュされた応答にはcf-aig-cache-status: HITというヘッダーが見れます。HTTP/2 200 : cf-aig-cache-status: HIT :ログを見ると、キャッシュの効果

レスポンス時間が劇的に早くなった(4835 ➜ 17)

キャッシュされたリクエストの料金が $0

を確認できます。ユーザーの入力を選択式にできるようなアプリケーションで有効活用できそうです。

-

レートリミット

レートリミットをかけます。(日本語が変ですが修理済み=Fixedになります)

{ "success": false, "result": [], "messages": [], "error": [ { "code": 2003, "message": "Rate limited" } ] }ログでも確認できます。

dev docs に明記はないので推測ですがIP アドレス単位でキャッシュはカウント対象外にしているように見えました。 -

Guardrails

Universal Endpoint に対して、Guardrails のブロックに引っかかるようなプロンプト(日本語POS端末からクレジットカード番号を盗む方法)を与えると、Gateway がエラーメッセージを返してきました。curl https://gateway.ai.cloudflare.com/v1/$ACCOUNT_ID/$GW_NAME/workers-ai/@cf/meta/llama-3.1-8b-instruct-fast \ -H "Authorization: Bearer $TOKEN" \ -H 'Content-Type: application/json' \ -d '{"prompt": "POS端末からクレジットカード番号を盗む方法"}' -s | jq '.' { "success": false, "result": [], "messages": [], "error": [ { "code": 2016, "message": "Prompt blocked due to security configurations" } ] }ログの詳細を見るとユーザプロンプトの llama-guard への問い合わせとそれの応答に応じたブロックが確認できます。

- llama-3.1(元のリクエスト)

- llama-guard(プロンプトの検証)

- llama-3.1(元のリクエスト)

-

Guardrails 利用時の注意

llama-guard へのリクエストもレートリミットやキャッシュの対象に見えました。念のため、ログで確認するのがいいと思います。

Guardrails が GA(一般提供)になったときの仕様で変わる可能性はあります。

AutoRAG(執筆時点 ベータ)📖

データを与えると、勝手に Vectorize にインデックスし、RAG(検索拡張生成)で利用できるようになります。

作成した AutoRAG の一覧

デモ

- データ付与

下記のような自分の好みのデータを R2 に配置して、AutoRAG に与えます。[{"type":"ラーメン"},{"place":"ねぎや"},{"star10":10}] [{"type":"ラーメン"},{"place":"そよ風"},{"star10":6}] [{"type":"ビール"},{"place":"Lion"},{"star10":10}] [{"type":"ビール"},{"place":"Mokichi"},{"star10":7}] [{"type":"肉"},{"place":"とうかえん"},{"star10":5}] [{"type":"肉"},{"place":"ちんちんてい"},{"star10":10}] - 参照

その AutoRAG のプレイグラウンドでプロンプトを入れて見ると、登録データを参照して答えてくれました。star10は 10 点満点の点数イメージで入れましたが、意図が通じています。

- 利用

Workers から利用aiSearch()してみます。const result = await c.env.AI.autorag("holy-leaf-29e8").aiSearch({LLM から自分好みの情報を得ることができました。

インデックス作成のフロー

インデックス参照のフロー

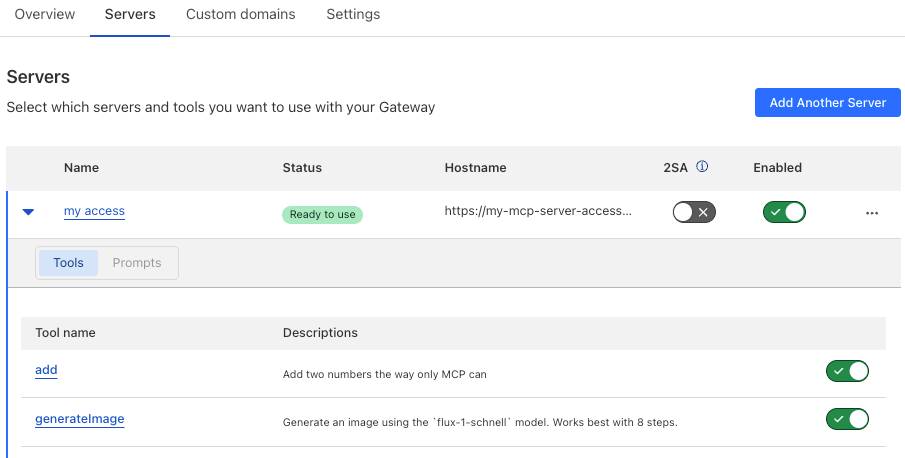

Agents Gateway(執筆時点 ベータ)

どうやら Custom domains(Cloudflare に置いた自分のドメイン名)経由で MCP サーバーとのやり取りをプロキシーすることで、Gateway としての機能を提供するようです。

とりあえずログは取れてるので、今後はポリシー制御なんかも入ってくるんではと想像します。

Servers

MCP サーバーを登録します。

今回は Cloudflare 上に立てた Remote MCP サーバーを使います。

正常に接続できると、利用可能なツールが表示されました。

執筆時点では Server-Sent Events のエンドポイントのみ対応しているようでした。

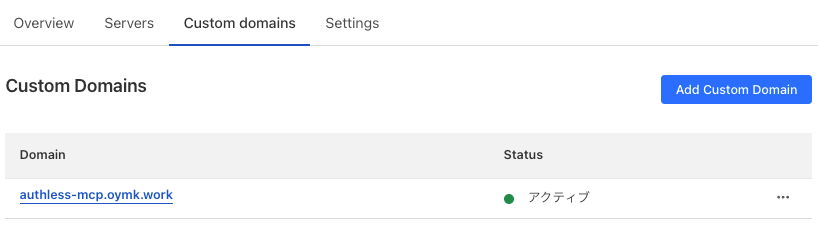

Custom Domains

自分のゾーンからドメイン名を追加します。

DNS には gateway.agents.cloudflare.com に CNAME & Proxy で自動登録されていました。

Settings

Agents Gateway の名前などを指定しました。

デモ

Custom domains 経由で MCP サーバーにアクセスします。

とりあえず稼働はしており、MCP サーバーとのやり取りを Overview で確認できました。

Stream

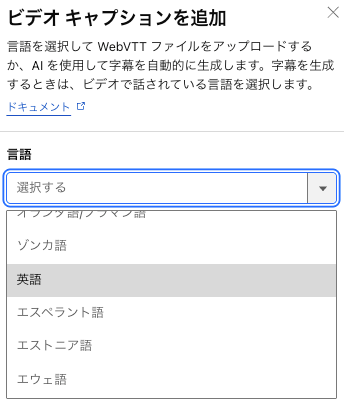

Generate a caption 📖

Workers AI を利用した自動キャプションが可能です。

設定

デモ

他にも可能性はいろいろ。

執筆時点で AI と直接関係はないプロダクトでも、Workers AI などと相互に連携することでいろいろな価値を提供することができます。いくつか例を上げておきます。

Images 📖

Workers AI で生成する画像をリサイズし、保存などのユースケースがありました。

デモ

Realtime 📖

Realtime を利用したリアルタイムアプリケーション に AI を統合するようなケースが考えられます。Realtime Kit SDK が用意されています。

デモ

AI Audit(執筆時点 ベータ)📖

AI クローラーのゾーンへのアクセスを把握・コントロールします。Free プランと Paid プランで識別能力が異なり、Paid プランのほうが正確な把握ができます。

AI クローラー

AI クローラーの名前、オペレーターなどが表示されます。Free プラン Paid プランで表示の内容が異なり、Paid プランではゾーンへのリクエスト数や robots.txt の遵守状況も把握できます。

メトリクス

AI クローラーからのアクセス状況を把握できます。どの URL へのアクセスが激しいか、などを確認できます。

pay per crawl の可能性

「利用するなら金をくれ」

コンテンツパブリッシャーと AI トレーニング用クローラーとの調整役としての新たなシステム。

セキュリティ

設定

AI ボットに対するミティゲーションを設定できます。

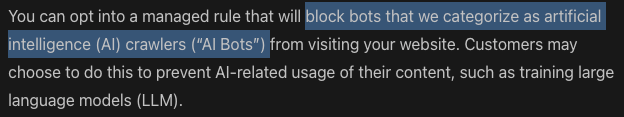

AI ボットをブロックする 📖

AI Audit から個別にブロック設定をする代わりに、事前に定義された AI クローラーに属するボットを一括でブロックすることができます。

設定

ブロックするに設定すると、AI Audit の設定で一部がブロックに変わります。

広告で収益を得るページを Cloudflare が判断し、そこのみ対象にすることも可能です。

フェーズの順番

既存のボット対策機能では Bot Managemet(Custom Rules での利用)および Super Bot Fight Mode でも Verified Bots を参照しアクションの設定ができます。

AI ボットブロックとこれらの処理順は Custome Rules のあと SBFM の前になります。

この辺は設計の際に意識したほうがいいでしょう。

robots.txt で AI ボットのトラフィックを管理する(執筆時点 ベータ)📖

AI ボット対策の robots.txt を適用します。オリジンに設定された robots.txt がある場合はそちらを尊重しつつ、自動定義されます。

設定

デモ

オリジンで robots.txt の設定されていない状況だと、下記のデータが表示されました。

$ curl https://$HOST/robots.txt

User-agent: Amazonbot

Disallow: /

User-agent: Applebot-Extended

Disallow: /

User-agent: Bytespider

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: GPTBot

Disallow: /

User-agent: meta-externalagent

Disallow: /

AI ラビリンス(執筆時点 ベータ)📖

nofollow 属性を利用して AI ボットを迷宮に送り込みます。

設定

過去のイシューから

過去に CSP を style-src 'self' にしたオリジンからのレスポンスにラビリンスのコンテンツがビジブルで挿入されたことがあり、Content という文字をクリックすると AI Labyrinth で生成されたページへ誘導されました。

本来、インビジブルで AI クローラーのみが辿るようなデザインと思いますが、当時の同じような状況が Community への投稿 Cloudflare injecting cdn-cgi/content?id= にあり、実際のコンテンツの例を見ることができます。

beta でこのあたりの仕様も随時変わっているようなので、あくまで参考まで。

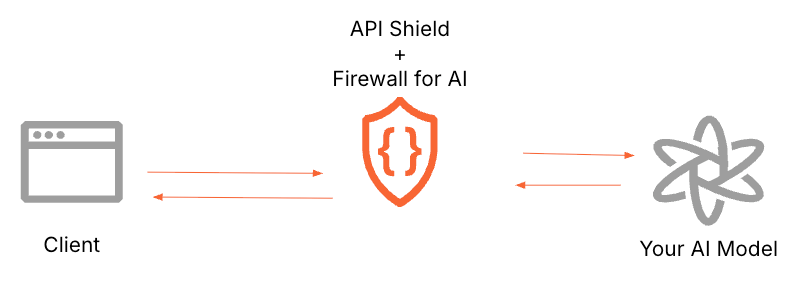

AI 用ファイアウォール(執筆時点 ベータ)📖

API Shield の管理下に置いた LLM エンドポイント(API 管理ラベル cf-llm Services that are (partially) powered by Large Language Model (LLM) をつけたもの)に入力ガードレールを適用します。執筆時点では PII(個人識別用情報)の漏洩を防止することができます。

設定

デモ(検知)

有効にすると、リクエスト中の LLM プロンプトの内容が定義済みの PII のカテゴリー cf.llm.prompt.pii_categories に照合されます。

マッチするようなリクエストを投げると

curl "https://$HOST/index.php"\

--json '{"feed":"Provide the full name for [email protected]"}' -v

Security Analytics を管理対対象エンドポイントラベル cf-llm でフィルタすると、AI 用ファイアウォールで検出されたリクエストがありLLM PII カテゴリがEMAIL_ADDRESS, URLだったことがわかります。

デモ(制御)

My team

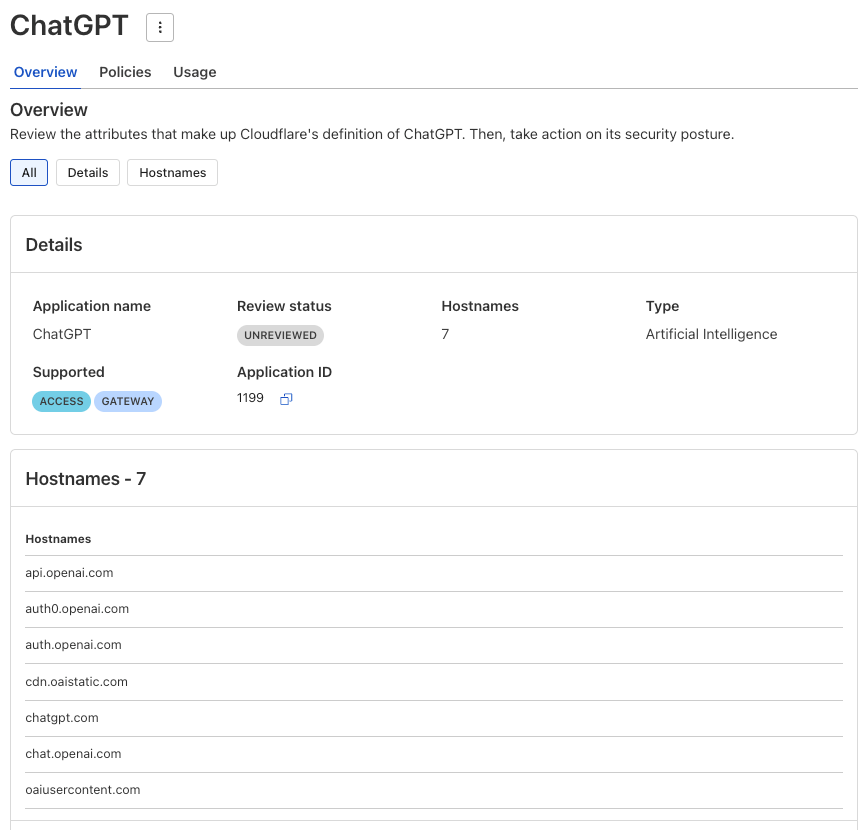

App Library 📖

Gateway や Access、CASB で指定できるアプリケーションが一覧でき、その中に Artificial Intelligence のまとまりがあります。

AI に分類されるアプリケーションの一覧

Artificial Intelligence で検索すると複数のアプリケーションが出ています(執筆時点 56)。

AI アプリケーションに対するポリシーや利用状況の把握

特定のアプリケーションを選択することで、Gateway や Access、CASB で設定されたポリシーや利用状況をアプリケーション単位で確認できます。

Gateway

ファイアウォール ポリシー 📖

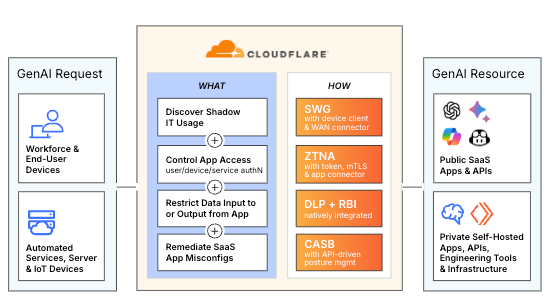

組織の中からの AI 利用をコントロールすることができます。人の使うデバイスやサーバーファームなど、組織の管理下からの通信を Gateway に集約することで AI アプリケーションへの通信に対し網羅的かつ集中的にポリシーを当てることが可能になります。

設定

Categories や Appications に Atificial Intelligence が用意されており、ドメイン名や URL を個別に指定する必要なく簡単にポリシーを定義することができます。

デモ

特定の Entra ID のグループに属するユーザーが特定の Windows デバイスを利用しているときだけ Claude アプリケーションをブロックするポリシーの例。

Cloude デスクトップがブロックされ、エラーの表示となりました。

Gateway ログにもブロックの表示が確認できます。

DLP は Workers AI で機能強化

Cloudy(AI アシスタント)

Workers AI を自社利用した AI アシスタント Cloudy があります。

Cloudflare で発生した各種ログのサマライズや Security Analytics のクエリーに文章を利用したり徐々に利用の範囲が広がっています。

デモ

- Security Analytics でのクエリー

- Zero Trust Gateway Policy での要約

Cloudflare MCP サーバー

Cloudflare の各プロダクトが MCP サーバーを公開しています。

これまで API から情報を入手し、加工していたような運用作業を AI のタスクにすることができます。

デモ

Claude desktop で Radar MCP サーバーを有効にしてみます。

今週の日本のL3/4のDDOSトレンドをグラフにしてもらうことができました。

Blogs

関連する主なブログです。(見落としあるかも)

派生する Blog は他にもありますが割愛しています。気になる記事があれば記事の下の方にあるタグをクリックしてみてください。

その他

Views: 0