【コスパの神】HJCE iPad用ペン 2025年発売iPad/iPad Air対応 アップルペンシル 超急速充電 タッチペン スタイラスペン ピクセルレベルの精度と低いレイテンシー ipadペンシル対応 磁気吸着/傾き感知/パームリジェクション 2018年以降iPad/iPad Pro/iPad Air/iPad mini対応(ホワイト)

¥1,139 (2025年5月1日 13:13 GMT +09:00 時点 - 詳細はこちら価格および発送可能時期は表示された日付/時刻の時点のものであり、変更される場合があります。本商品の購入においては、購入の時点で当該の Amazon サイトに表示されている価格および発送可能時期の情報が適用されます。)【専用ケースプレゼント】android 15 タブレット 11インチ 12GB+128GB+1TB拡張 アンドロイド Tablet YouTube視聴 8コアT606 wi-fiモデル 大画面 8000mAh大容量 GPS対応 GMS認証 BT5.0 顔認識 画面分割 無線投影 タイプC充電 高性能 SVITOO P11 ケース付き

¥13,380 (2025年5月1日 13:06 GMT +09:00 時点 - 詳細はこちら価格および発送可能時期は表示された日付/時刻の時点のものであり、変更される場合があります。本商品の購入においては、購入の時点で当該の Amazon サイトに表示されている価格および発送可能時期の情報が適用されます。)

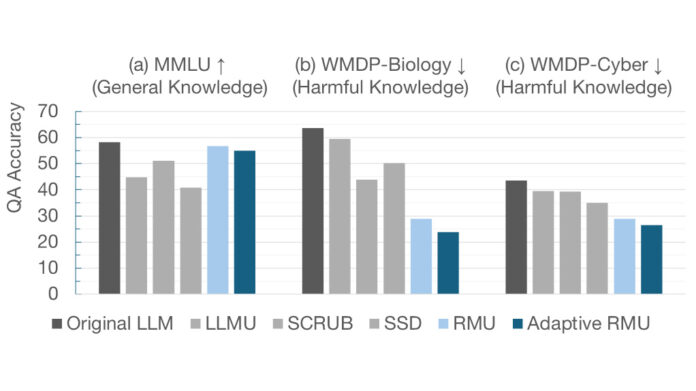

北陸先端科学技術大学院大学の研究グループは、大規模言語モデル(LLM)が学習した有害な知識を消去する新たな手法「Adaptive RMU」を発表した。

さまざまな分野でLLMの活用が進む中、学習したデータに機密情報や有害な知識が含まれると、意図せずそれを出力してしまう可能性がある。これに対応するため、特定の知識だけを選択的に忘れさせる技術が注目されている。

中でも、忘却対象となる知識に関連するLLMの内部表現をランダム化し、モデルが知識を活用できなくする「Representation Misdirection for Unlearning」(RMU)という手法が有望視されている。だが、理論的な動作原理の解明が十分ではなく、効果の最大化には、LLMや忘却させたい知識にあわせ、大きな計算リソースを使って最適化する必要があり、ボトルネックとなっていた。

研究グループでは、RMUを理論面と実データの両面から詳細に分析し、改良版となるAdaptive RMUを考案。これまで手探りで調整していた制御パラメータを自動化し、最適化コストの大幅な削減に成功した。

また、RMUと同等の忘却性能を維持しながら、LLMの一般的な言語理解能力をほとんど損なわず、有害情報に関する質問の正答率を大幅に下げる効果も実証。さらに、忘却後のLLMから有害知識を抜き出そうとする「知識復元攻撃」に対する高い防御性能も実現したという。

今回の成果により、チャットボットや自動応答システムといったLLMを活用するあらゆるサービスで、個人情報や機密情報の漏洩リスクの低減が期待できるとしている。

Views: 0