株式会社ナレッジセンスは、生成AIやRAGを使ったプロダクトを、エンタープライズ向けに開発提供しているスタートアップです。本記事では、専門家のようなレポートを、図表付きで生成できる AIエージェント を実装するための手法について、ざっくり理解します。

この記事は、RAGの新手法である「Multimodal DeepResearcher」の論文について、日本語で簡単にまとめたものです。

今回も「そもそもRAGとは?」については、知っている前提で進みます。確認する場合は、こちらの記事もご参考下さい。

ざっくりサマリー

最近、OpenAIの「Deep Research」機能が話題です。この機能では、Web上の情報をもとに深く考え、高精度な回答をすることができます。ただ残念ながら、現在のところ本家「Deep Research」では、テキスト(文字)だけでしか出力できません。

今回の「Multimodal DeepResearcher」の論文では、単なるテキストだけでなく、「図表・チャート入り」で、品質の高いレポートを出せるようにする ための手法です。

この手法のキモは、FDV (Formal Description of Visualization) という、チャートのデザインを構造的に記述するための 独自フォーマットを導入した 点です。これにより、LLMが人間のお手本レポートから「良いチャートデザイン」を学び、自律的に、高品質なチャートを生成できるようになります 。

問題意識

問題意識はシンプルです。「Deep Research」機能は便利だけど、アウトプットの結果が文字ばかりで見づらくなってしまうよね。ということです。

そもそも去年まで、LLMの出力は 「テキストだけ」でも十分 でした。というのも、これまでの通常のLLMや、シンプルなRAGの回答内容だと、そこまで長い文章にならなかったからです。

しかし、現在話題になっている「Deep Research」機能では、大量のレポートから、重厚長大なレポートを作成します。こうなると、テキストだけだと、レポートを直感的に理解することは出来ません。

手法

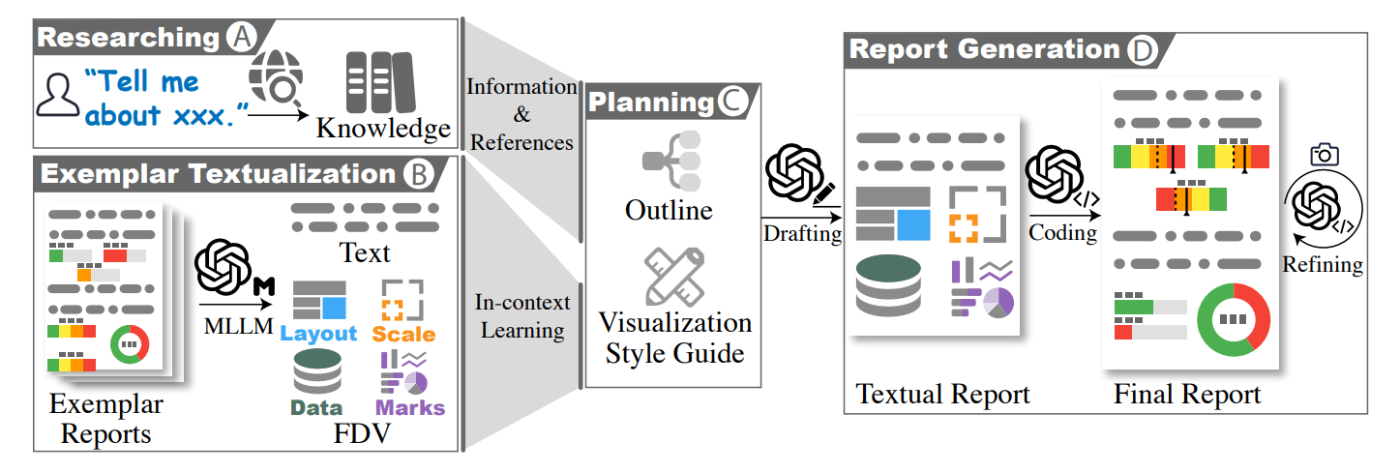

Multimodal DeepResearcherでは、以下のステップで、出力するレポートに図表を入れ込みます。

【事前にやっておくこと】

-

「お手本レポート」の収集

- インターネット上のソースから、テキスト+高品質チャートを含むレポート(※もちろん人間が作成したもの)を収集しておく。

- (例えば、Pew Research Center や Our World in Data などから6個くらい収集)

【ユーザーが質問を入力して来たとき】

-

シンプルなDeep Reaserach

- まず、ユーザーの質問に回答するために、「Web検索↔考察」のサイクルを自律的に実行してテキストで情報収集。(ここまでは通常のDeep Reaserach)

-

お手本のテキスト化

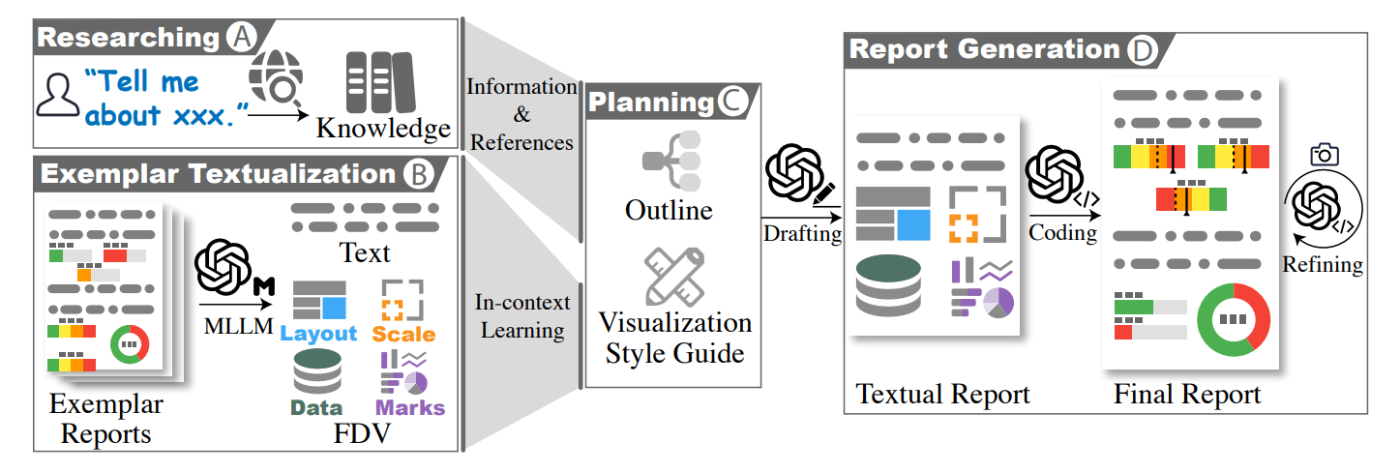

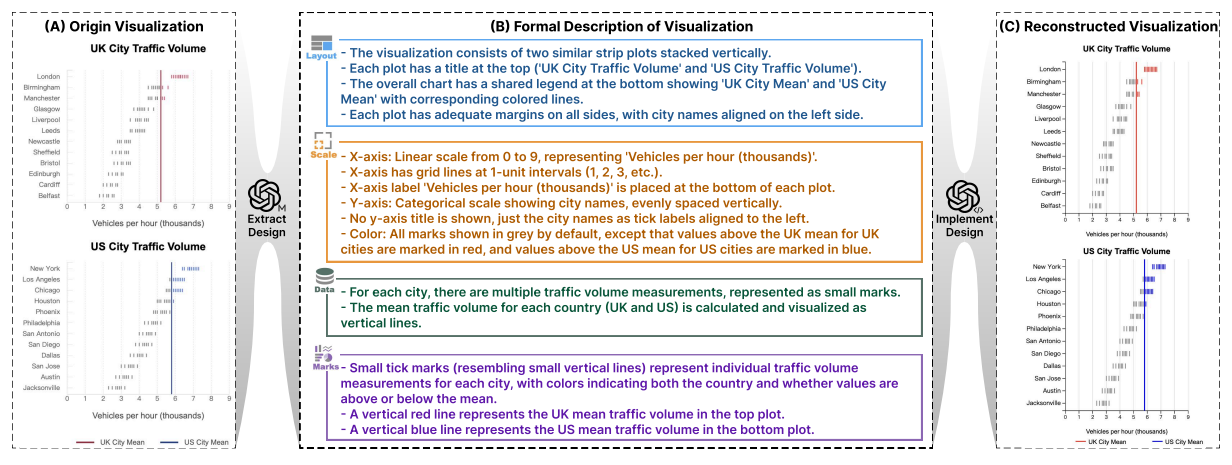

- 事前に用意したお手本レポート内のチャートを、FDVという統一テキスト形式に変換。

- FDVとは、チャートを「レイアウト」「プロットのスケール」「データ」「マーク(棒や線などの要素)」の4つの観点で構造的に記述するフォーマット。

- これにより、LLMは、「どのような文脈で、どのようなデザインのチャートが使われるか」を理解可能に。

(下記はFDVの図解↓)

-

計画

- 1と2を基に、レポート全体の構成(=アウトライン)と、チャートデザインの統一ルール(=スタイルガイド)を作成。

-

レポート生成

- まず、計画に沿って、テキストとFDV(チャートの設計図)を含む下書きを生成。

- FDVをチャート画像に変換し、LLMが「評価↔修正」を繰り返して自律的に質を高める。

- 下書きのFDVを、完成したチャート画像に差し替えて、最終的なレポートを完成

成果

まず前提として、今回の検証のために、100のトピックからなる独自の評価データセット「Multimodal ReportBench」が構築されています。以下、これを使って評価しています↓

- Claude 3.7 Sonnet を使用した場合、ベースライン手法(DataNarrativeを改良したもの)に対して82%という高い勝率

- Qwen3/Qwen2.5-VL などのオープンソースモデルでも、ベースラインを上回る性能

- ベースラインと比較して、より複雑で多様なチャートを生成できることが示された

※ただし、生成されたチャートの要素が重なってしまう問題や、データの無い部分を捏造してしまう問題(ハルシネーション)も報告されています。

弊社では普段、エンタープライズ企業向けにRAGサービスを提供しています。既に「Deep Research」機能も自前で実装し、公開していますが、やはり、「プレゼンや会議の資料で使いたい」というユーザーは多いです。

テキストだけの資料でも便利ですが、ここで自動的に図表・チャートが挿入されたらさらに便利になりそうです。

2025年のRAGシステムでは、インプットもアウトプットも、さらに「マルチモーダル化」していくと予想しています。我々のようなRAG/AIエージェント開発者側としては大変ですが、ますます便利になるのは間違いなさそうです。

みなさまが業務でRAGシステムを構築する際も、選択肢として参考にしていただければ幸いです。今後も、RAGの回答精度を上げるような工夫や研究について、記事にしていこうと思います。我々が開発しているサービスはこちら。

Views: 0